- Más de la mitad de las niñas y adolescentes usuarias de internet en México han sufrido acoso digital; casos recientes de deepfakes evidencian violencias sexualizadas amplificadas por IA, mientras leyes como Olimpia buscan sancionar estos delitos y proteger a las víctimas

En México, más de 10.6 millones de mujeres usuarias de internet, el 22% del total, han sufrido algún tipo de violencia digital, que incluye ciberacoso, amenazas, discursos de odio, difusión no consentida de material sexual y la creación de imágenes o videos sexualizados mediante inteligencia artificial sin consentimiento, como los deepfakes, según el Módulo sobre Ciberacoso (MOCIBA, 2024) del Instituto Nacional de Estadística y Geografía (INEGI). Entre las víctimas, las mujeres de 20 a 29 años son las más afectadas, y cuando identifican a sus agresores, el 87% son hombres.

Sin embargo, la violencia digital comienza desde edades tempranas, ya que más de la mitad de las niñas y adolescentes usuarias de internet han sido víctimas de acoso en línea, reportando su primera experiencia entre los 14 y los 16 años.

Estas agresiones reproducen patrones de poder y control presentes en la violencia fuera de línea, pero se amplifican por la velocidad y el alcance de las plataformas digitales, provocando que los impactos sobre las víctimas sean más duraderos y difíciles de manejar.

Generación masiva de imágenes sexualizadas en CDMX y Grok

Los deepfakes, término que combina fake (falso) y deep learning (aprendizaje profundo), son archivos de video, imagen o audio generados artificialmente para imitar la apariencia y la voz de una persona. Su realismo es tan alto que rara vez se pueden distinguir a simple vista o al oído.

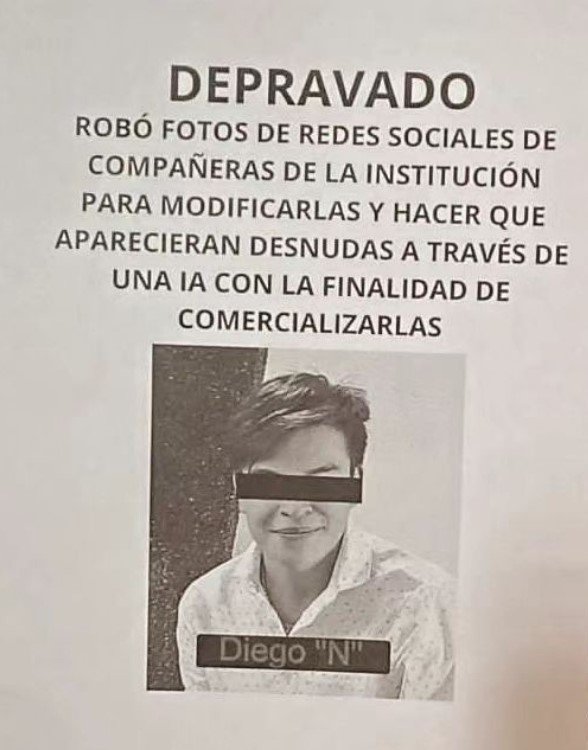

En la Ciudad de México, el fenómeno ganó notoriedad en 2023 cuando ocho estudiantes del Instituto Politécnico Nacional (IPN) denunciaron que un compañero tenía en su posesión un dispositivo con más de 166,000 fotografías y unos 20,000 videos con contenido sexual real o alterado mediante inteligencia artificial, muchos con los rostros de las estudiantes sin consentimiento.

Las jóvenes relataron que las imágenes y videos, algunos manipulados digitalmente para parecer íntimos, se compartían y vendían en grupos de mensajería, lo que provocó protestas estudiantiles y exigencias a las autoridades para reconocer la violencia digital como una forma real de agresión.

Otro caso reciente reveló la magnitud del problema a nivel global cuando, entre el 29 de diciembre de 2025 y el 8 de enero de 2026, tras el anuncio de Elon Musk de que sería posible editar imágenes publicadas “con un solo clic”, se generaron aproximadamente 190 imágenes sexualizadas por minuto durante 11 días, según el Center for Countering Digital Hate (CCDH).

La organización analizó aleatoriamente 20,000 publicaciones creadas por el chatbot Grok, utilizando una herramienta de IA con un índice F1 del 95% para identificar contenido sexualizado, complementada con un manual de revisión específico para casos que involucraban menores.

De la muestra, el 65% de las imágenes eran sexualizadas, extrapolando un total cercano a tres millones de imágenes, de las cuales el 0.5% involucraba a niñas y niños, equivalente a aproximadamente 23,338 representaciones.

Avances legales en México

En México, la protección frente a la difusión de contenido íntimo no consensuado ha dado pasos importantes con la “Ley Olimpia”, un conjunto de reformas a la Ley General de Acceso de las Mujeres a una Vida Libre de Violencia y al Código Penal Federal que reconoce y sanciona la violencia digital y mediática. La ley establece que la difusión, producción o intercambio de contenido íntimo, sexual o erótico sin consentimiento constituye un delito.

Además, en enero de 2024, el Congreso de Sinaloa aprobó reformas al Código Penal para tipificar específicamente el uso de inteligencia artificial en la manipulación de imágenes íntimas. La Corte validó el Artículo 185 Bis C, que define la inteligencia artificial en el contexto de la violencia digital como “aplicaciones, programas o tecnología que analice fotografías, audios o videos y ofrezca ajustes automáticos para hacerles alteraciones o modificaciones”.

Las penas establecidas oscilan entre tres y seis años de prisión, además de multas que van de quinientos a mil días.

¿Qué hacer si eres víctima de deepfakes?

El impacto de los deepfakes sexuales incluye daños reputacionales difíciles o incluso imposibles de revertir, ya que la difusión de contenido falso puede afectar de manera permanente la percepción pública de las víctimas.

Estos materiales se emplean en esquemas de extorsión y chantaje (sextorsión), donde se amenaza a las personas con difundir el contenido manipulado para obtener dinero, favores o información.

Si detectas material manipulado, se recomienda seguir estos pasos:

- Captura pantallas, enlaces, marcas de tiempo y cualquier información que respalde una denuncia legal.

- Utiliza las herramientas de X, Meta, Instagram u otras redes donde se difunda el contenido para solicitar su eliminación.

- Eliminar contenido masivo:

- StopNCII.org: genera una “huella digital” o hash de la imagen para que los algoritmos de plataformas aliadas detecten y eliminen duplicados automáticamente

- Take It Down: protege especialmente a menores de 18 años al solicitar la eliminación de contenido sexual explícito distribuido sin consentimiento

Asimismo, se recomienda buscar apoyo legal y psicológico contactando a Defensoras Digitales o a la Policía Cibernética de CDMX al 55 5242 5100, que ofrecen orientación y acompañamiento profesional.